Apple, технологический гигант, выпускает исследование, чтобы доказать, что современные ИИ-модели не умеют думать. А через пару дней их собственный объект критики, модель Claude Opus, становится соавтором статьи, которая разносит их выводы в пух и прах. Иронично. Давайте разберем, что произошло.

Генеральный директор Anthropic Дарио Амодей в своем недавнем эссе подчеркнул острую необходимость в лучшем понимании работы моделей ИИ ("интерпретируемость"), назвав их текущее состояние "черным ящиком". Он поставил перед Anthropic амбициозную цель – научиться надежно выявлять большинство проблем моделей ИИ к 2027 году.

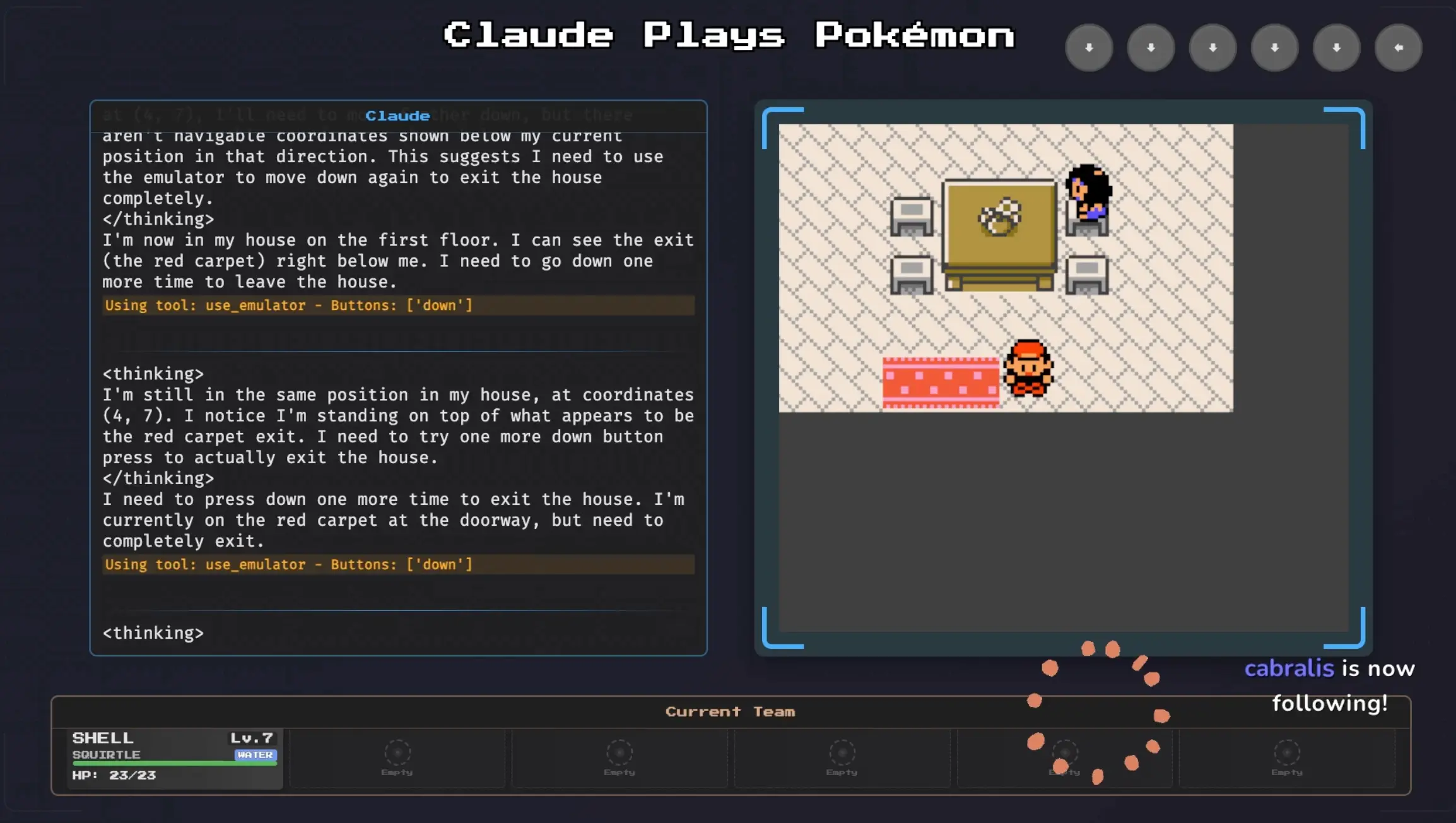

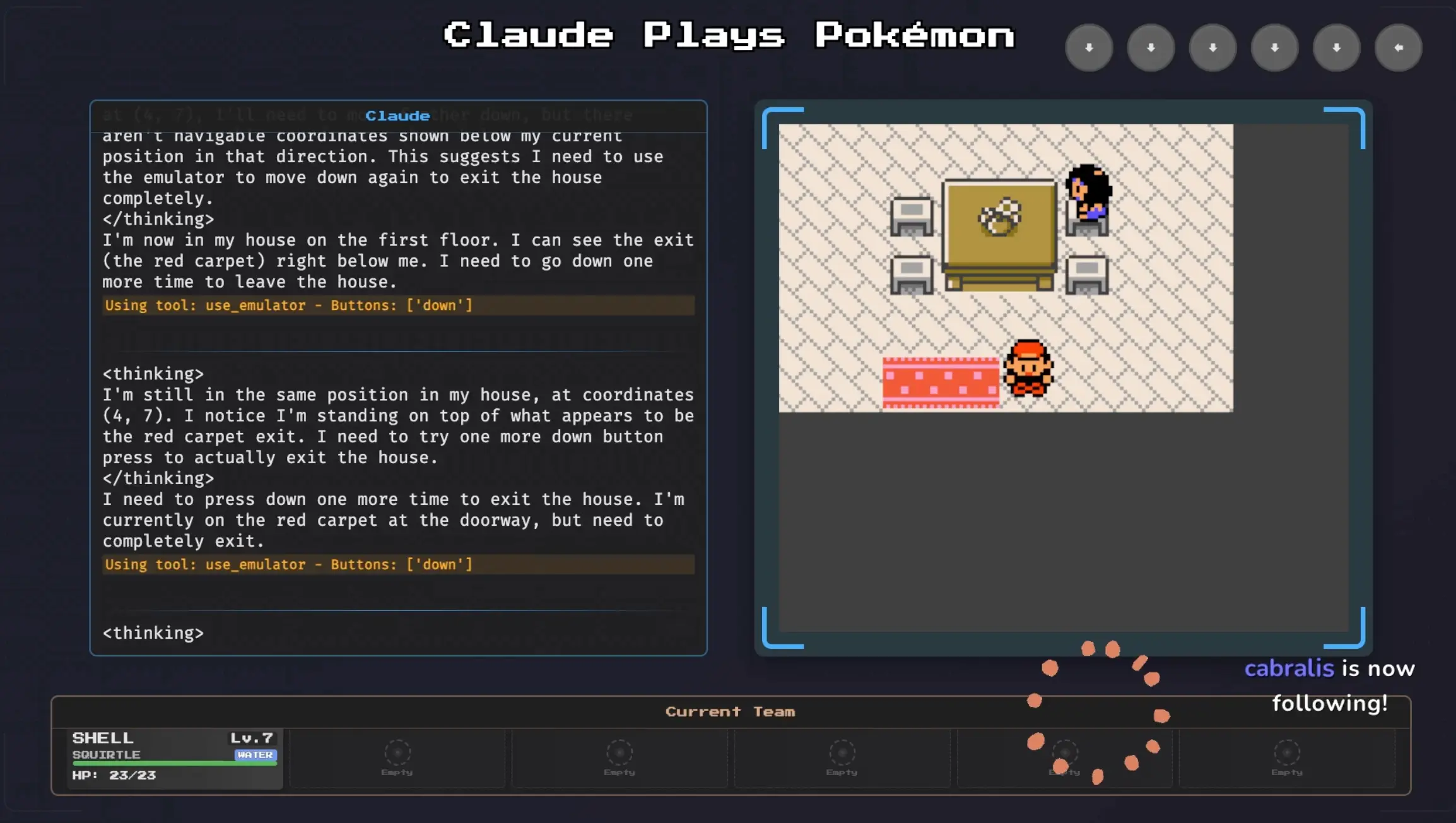

В эпоху, когда нейросети рисуют картины и пишут стихи, компания Anthropic решила проверить своего нового AI-гиганта Claude 3.7 Sonnet старомодным способом – заставила его играть в Pokémon Red. И результаты, скажем так, заставляют задуматься, ведь даже самые простые задачи заставляют искусственный интеллект напрячь все свои вычислительные мощности.

Anthropic представила обновленную линейку своих ИИ-моделей — Claude 3.5 Sonnet и Claude 3.5 Haiku, а главное — революционную функцию управления компьютером. Claude 3.5 Sonnet существенно превзошел своего предшественника, особенно в области программирования, где он и раньше занимал лидирующие позиции. Младшая модель, Claude 3.5 Haiku, не уступает по возможностям прежнему флагману Claude 3 Opus, при этом работает быстрее и стоит дешевле.